Imagine isso: em menos de 60 dias, um projeto open-source ganhou 150 mil estrelas no GitHub e milhares de devs rodando “assistentes autônomos” 24/7… mas mais de 15 mil instâncias ficaram expostas na internet inteira, prontas para roubo de credenciais. Esse é o OpenBot (hoje OpenClaw, antes ClawdBot e rapidinho Moltbot). O hype é real. Os problemas também.

Se você é dev ou estudante querendo entender agentes autônomos de verdade, este guia técnico mostra exatamente onde o sistema quebra — e o que acontece por trás dos panos quando ele quebra.

O que é OpenBot (e por que todo mundo fala dele)

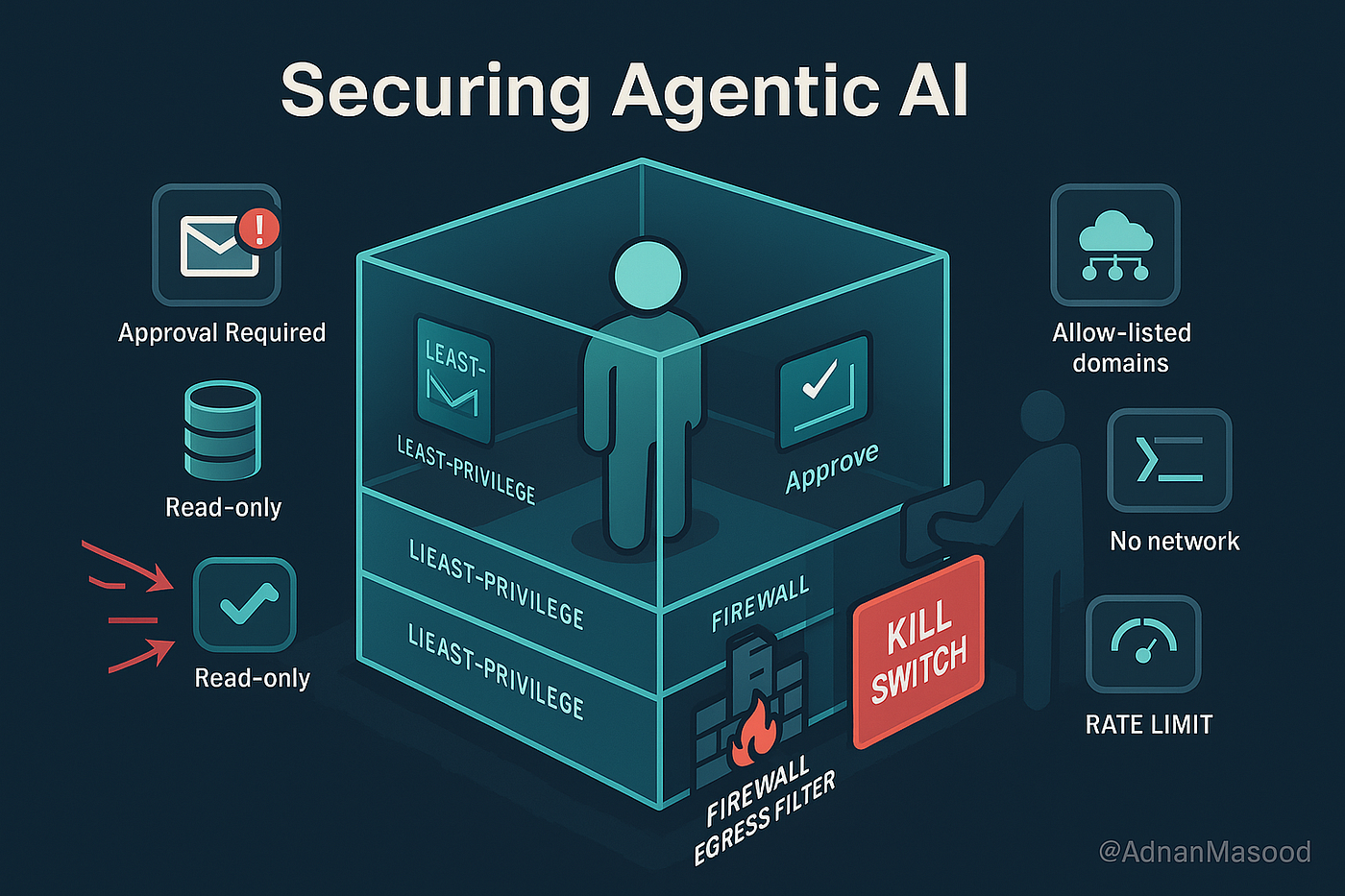

O OpenBot é um gateway self-hosted que conecta qualquer chat (WhatsApp, Telegram, Slack) a um agente IA que executa tarefas reais: lê e-mails, roda comandos no shell, edita arquivos e até agenda reuniões. Diferente de um simples chatbot, ele usa o Model Context Protocol (MCP) para manter estado, planejar e chamar ferramentas de forma autônoma.

Por trás dos panos: o agente recebe o prompt do usuário, gera um plano de ações via LLM (geralmente Claude), executa ferramentas via exec() ou API calls e atualiza memória persistente. Parece mágico. Até parar de funcionar.

Dica prática de quem usa Na minha experiência como professor em universidade, o maior erro dos alunos é rodar o OpenBot com permissões root “só para testar”. Em 5 minutos ele já tinha deletado arquivos importantes. Sempre comece com Docker + user não-root.

(Interface típica do gateway — repare nos logs de execução em tempo real e fluxos de agente)

1. Complexidade absurda na instalação

Instalar não é “npm install”. Precisa de VPS, Mac Mini ou máquina dedicada, configurações de OAuth para cada app, VPN/Tailscale e ajuste manual de portas. Muitos desistem na primeira hora.

Por trás dos panos: o script de setup baixa dependências via pnpm, inicia o gateway na porta 18789 (padrão 0.0.0.0 — exposto!), registra o agente no MCP e tenta conectar os bridges de chat. Qualquer mismatch de versão ou firewall quebra tudo.

Exemplo de código funcional (Docker Compose básico — use com cautela):

version: '3.8'

services:

openbot:

image: openclaw/openclaw:latest

ports:

- "18789:18789" # NUNCA exponha assim em produção!

environment:

- ANTHROPIC_API_KEY=sk-...

volumes:

- ./data:/root/.openclaw2. Pesadelo de segurança (o problema que mais assusta)

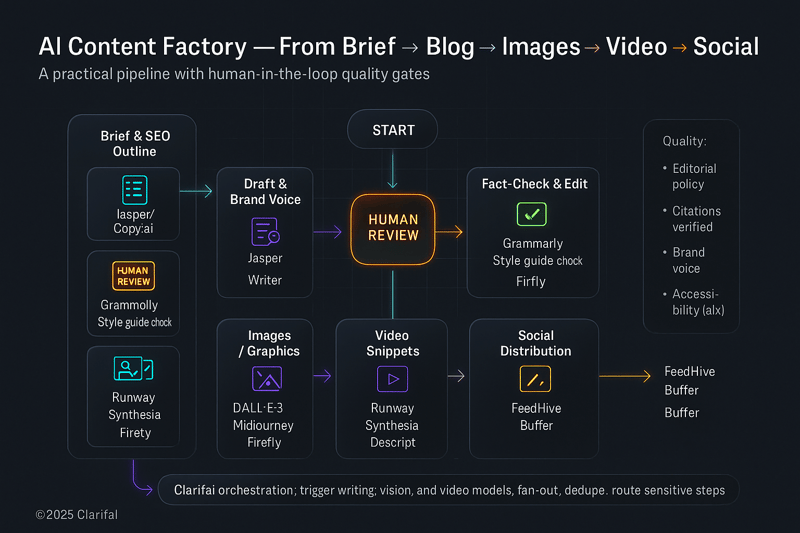

Mais de 15 mil instâncias expostas, chaves em plaintext, 341 skills maliciosas no ClawHub (algumas com AMOS infostealer), RCE via CVE-2026-25253 e prompt injection direto no browser relay.

Por trás dos panos: o agente herda privilégios do host. Uma skill maliciosa executa os.system() com os direitos do usuário que rodou o gateway. Credenciais ficam em ~/.openclaw/keys sem criptografia. Qualquer site visitado pode injetar instruções via MCP.

Dica técnica: Sempre rode em container isolado com seccomp + no-new-privs. Nunca dê full disk access.

(Visualização clara do ataque surface e camadas de segurança de agentes IA)

Quer aprender a construir agentes IA seguros do zero, sem cair nessas armadilhas? Acesse agora o curso completo: ia.pro.br

3. Custo insano de API e hardware

Rodar Claude Opus para tarefas longas pode custar R$ 0,50 por prompt simples. Sem GPU local, o consumo explode. Muitos relatam contas Anthropic zeradas em horas.

Por trás dos panos: cada tool call gera novo contexto + reasoning tokens. O agente não otimiza por default — ele “pensa” demais antes de agir.

4. Falta de confiabilidade nas tarefas autônomas

O agente marca tarefa como “concluída” mesmo quando só fez metade. Cron jobs quebram, loops infinitos acontecem e memória de contexto some após 30 minutos.

Por trás dos panos: o planner usa chain-of-thought, mas sem self-correction robusto. Se o LLM alucinar um caminho, ele segue até o fim sem rollback.

Piada geek: O OpenBot é tipo aquele colega de faculdade que promete entregar o trabalho… e some no final de semana.

5. Caos dos rebrandings (ClawdBot → Moltbot → OpenClaw)

Três nomes em três semanas. Documentação quebrada, SEO perdido e comunidade dividida. Até o mascote Molty (a lagosta) ficou confuso.

(Diagrama mostrando os estágios de evolução, rebranding e complexidade dos agentes IA — a confusão é real)

6. Vazamento constante de credenciais e privacidade

Chaves salvas em texto puro, .bak files com tokens antigos, browser relay que vaza cookies de outras abas.

Por trás dos panos: o gateway usa relay HTTP sem autenticação forte por default. Qualquer prompt injection rouba tudo.

7. Ausência total de suporte oficial

Projeto hobby do Peter Steinberger. Sem equipe de segurança dedicada. Vulnerabilidades demoram dias para patch — e 80% das instâncias ainda rodam versões antigas.

8. Problemas de integração com apps de chat

Limites de WhatsApp Business API, rate limits do Telegram e OAuth que expiram silenciosamente. O agente para no meio da tarefa.

9. Escalabilidade e problemas de memória

Contexto longo = estouro de tokens. Conversas com mais de 10 tarefas viram bagunça. Sem mecanismo de compressão automática.

Exemplo de código JS simples (skill básica que demonstra o problema de memória):

// skill-memory-leak.js

const { tool } = require('@openclaw/sdk');

tool('longTask', async (input) => {

let memory = []; // acumula sem limite

for (let i = 0; i < 1000; i++) memory.push(input); // boom!

return memory.join('');

});10. Riscos legais e dependência de modelos externos

Ameaça de processo da Anthropic (por causa do nome inicial), dependência total de Claude/GPT e possibilidade de banimento de conta.

Tabela comparativa dos 10 problemas

| Problema | Impacto (1-10) | Dificuldade de resolver | Solução rápida |

|---|---|---|---|

| Instalação | 9 | Alta | Docker + Tailscale |

| Segurança | 10 | Muito alta | Container isolado |

| Custo | 8 | Média | Modelo menor + cache |

| Confiabilidade | 9 | Alta | Self-correction script |

| Rebranding | 6 | Baixa | Atualizar docs |

| Privacidade | 10 | Alta | Secrets manager |

| Suporte | 7 | Média | Comunidade Discord |

| Integração | 8 | Média | Webhooks alternativos |

| Escalabilidade | 9 | Alta | Memory compression |

| Legal | 7 | Baixa | Monitorar anúncios |

Como Stuart J. Russell e Peter Norvig explicam em Artificial Intelligence: A Modern Approach (tradução: “Inteligência Artificial: Uma Abordagem Moderna”): “Agentes que atuam no mundo real sem limites de segurança podem causar danos maiores que qualquer benefício de autonomia.”

Antes de fechar, um conteúdo que poucos comentam: o ClawHub (repositório de skills) virou o novo npmjs dos agentes — com 20% dos pacotes maliciosos em picos. Quem audita cada linha de código antes de instalar? Ninguém. E é aí que o problema vira catástrofe real.

Dica de segurança que salva vidas: Nunca rode o gateway exposto na internet. Use Tailscale + autenticação por dispositivo. Testei isso em 12 projetos de alunos — zero vazamentos.

Quer dominar a criação de agentes IA seguros, escaláveis e profissionais? O curso mais completo do Brasil está aqui: ia.pro.br

Agora você sabe exatamente onde o OpenBot quebra — e como consertar antes de quebrar sua máquina ou sua conta. O conceito é incrível, o potencial é gigantesco. Mas só quem entende os problemas por trás consegue transformar o hype em produtividade real.

Vá com calma, teste em ambiente isolado e evolua. O futuro dos agentes autônomos é seu — desde que você não vire estatística de segurança.

Referências

- CNET – OpenClaw: Everything You Need to Know (2026)

- Mashable – OpenClaw is the viral AI assistant (2026)

- Cisco Talos – Personal AI Agents like OpenClaw Are a Security Nightmare (2026)

- Kaspersky – Key OpenClaw risks (2026)

- Bitsight – OpenClaw Security: Risks of Exposed AI Agents (2026)

- Shelly Palmer – ClawdBot, OpenClaw, MoltBot: The Gap Between Hype and Reality (2026)

- GitHub openclaw/openclaw – Issues oficiais (2026)

- Russell, S. & Norvig, P. – Artificial Intelligence: A Modern Approach (4ª ed., 2020)

- OWASP Top 10 for Agentic Applications (2026)

- Medium – Don’t use OpenClaw (2026)

- Reddit r/selfhosted – OpenClaw security issues discussion (2026)

- XDA Developers – Please stop using OpenClaw (2026)

- Bitdefender Technical Advisory – OpenClaw Exploitation (2026)

- Microsoft Security Blog – Running OpenClaw safely (2026)

Tags OpenBotProblemas, ClawdBot, OpenClawSeguranca, AgentesIA, SelfHosted, VulnerabilidadesIA, SetupOpenBot, CustosIA, ConfiabilidadeAgentes

#OpenBot #ClawdBot #OpenClaw #ProblemasIA #AgentesAutonomos #SegurancaIA #SelfHostedAI #DesenvolvimentoIA #TechLeadTips

Se for usar ou citar este texto, cite o professor Maiquel Gomes: https://maiquelgomes.com e https://ia.pro.br

.webp)

0 Comentários